Цифровые лица «Изгоя-один»

В 2017 году Американская киноакадемия наградила «техническим» «Оскаром» команду студии ILM за разработку лицевого солвера ILM. «Технический» «Оскар» (обычно это просто сертификат Академии киноискусства и науки США) вручается не за какой-то один фильм, а за многолетнюю разработку, повлиявшую на всю киноиндустрию в целом.

Итак, система позволяет с высокой точностью переносить данные, полученные при захвате мимики, с актеров на цифровых персонажей в больших масштабных проектах, сохраняя при этом полный творческий контроль. Также она стабильно переносит данные на новый риг в управляемом пайплайне.

Здесь, наверное, стоит пояснить пару терминов. Риг (от англ. «рычаг») — это виртуальная система управления анимационным персонажем и/или его элементами. Солвер (от англ. «решающее устройство») — софт, анализирующий данные, поступающие с лицевых камер захвата мимики и переносящий их на новый виртуальный риг. Пайплайн (от англ. «трубопровод») — система программных продуктов, в которых происходит обработка материалов в студии (часто одни элементы изображения создаются в одной программе, а другие — в другой, анимируются в третьей, а рендерятся — в четвертой, и тд).

Данную систему в ILM разрабатывали параллельно две команды на двух проектах. Киран Бат и Майкл Копервос занимались «Черепашками-ниндзя», где предстояло перенести игру актеров на черепашьи мордашки. Вторую команду студия сформировала, когда получила заказ на фильм «Варкрафт», где предстояло создать новый пайплайн для создания лиц орков и других цифровых персонажей. Над этим проектом работали Брайан Кантуэлл и Пейдж Уорнер. Обе команды действовали параллельно, общаясь между собой, но не сливали производство фильмов воедино до тех пор, пока не началась работа над «Пробуждением Силы».

«Черепашки-ниндзя» потребовали от студии более точного переноса захваченной мимики на лица: точки управления на них не совпадали с аналогичными на человеческих лицах (ре-таргетинг). Особенно это касалось артикуляции.

В то же время для «Варкрафта» нужно было создать гораздо больше виртуальных персонажей, ведущих беседы между собой. Этот проект потребовал разработки системы прямого автоматического переноса захваченных данных на виртуальные лица, поскольку любая необходимость ручной анимации раздула бы бюджет и увеличила время работы над проектом.

Как же создавались лица «Изгоя-один»?

Из этих данных можно составить любые переходы между любыми выражениями после создания уникального анимационного рига для этого конкретного лица. Этот риг станет главной отправной точкой для сбора и анализа данных при последующей работе.

И только теперь можно переходить, собственно, к актерской игре и сбору мимических данных на площадке. Именно эти данные будут двигать риг, о котором мы рассказали в предыдущем абзаце — все выражения лица актера «разберут» (с помощью того самого решающего устройства — солвера) на конкретные FACS-позы и их комбинации из составленной ранее библиотеки.

Иногда захват мимики производят в условиях лаборатории, а иногда — прямо на съемочной площадке. Бывает, что оба метода применяют параллельно. Впервые захват мимики на площадке применили на фильме «Аватар», и часть этой разработки принадлежит студии Weta Digital, но специалисты ILM тоже участвовали в этом процессе, и сегодня эта технология — общепринятая по всей индустрии.

Какие технологии пошли в ход?

Теперь, после попытки солвера приблизить результат работы на площадке к ранее заготовленным формам, команда ILM применяет второй уровень обработки — SnapSolver. Этот инструмент помогает перенести отснятый силуэт на 3D-модель. Это очень умная тактика, программный продукт, позволяющий добавить те самые 5% достоверности, которых не было раньше. Если первичный солвер подставляет заготовленные в покое формы лица (изгиб бровей или уголков губ), то SnapSolver берет этот результат и сравнивает силуэты «цифровой хоккейной маски» с отснятым лицом. Если силуэты не совпадают, то программа подгоняет их под отснятое. Когда речь идет о мягких тканях лица, таких, как губы и щеки, поправки оказываются очень значимыми.

Когда эту систему впервые создали для «Черепашек-ниндзя», работавшая над «Варкрафтом» команда так впечатлилась, что заставила SnapSolver работать еще активнее. Они усилили работу SnapSolver, чтобы добиться производства больших объемов лицевой анимации, необходимой для этого фильма. Кроме того, команда «Варкрафта» усовершенствовала трекинг глаз, но SnapSolver помог сохранить все нюансы актерской игры в цифровых персонажах.

Персонаж фильма «Черепашки-ниндзя»

Персонаж фильма «Черепашки-ниндзя»

Там, где команда «Черепашек-ниндзя» предлагала SnapSolver`у внести только небольшие, но крайне важные поправки, команда «Варкрафта» построила весь пайплайн так, чтобы SnapSolver проделал огромный объем работы. Они принесли в жертву возможность внесения поправок вручную аниматором, но получили более точный и быстрый перенос актерской игры с каждого дубля на цифровое лицо актера. А потом проделали ретаргетинг (перенос этих данных на лицо персонажа). Если режиссеру не нравился результат, они предлагали актерам сделать еще один дубль, но не опираться на ручную работу аниматора.

Но вернемся к «Изгою-один»

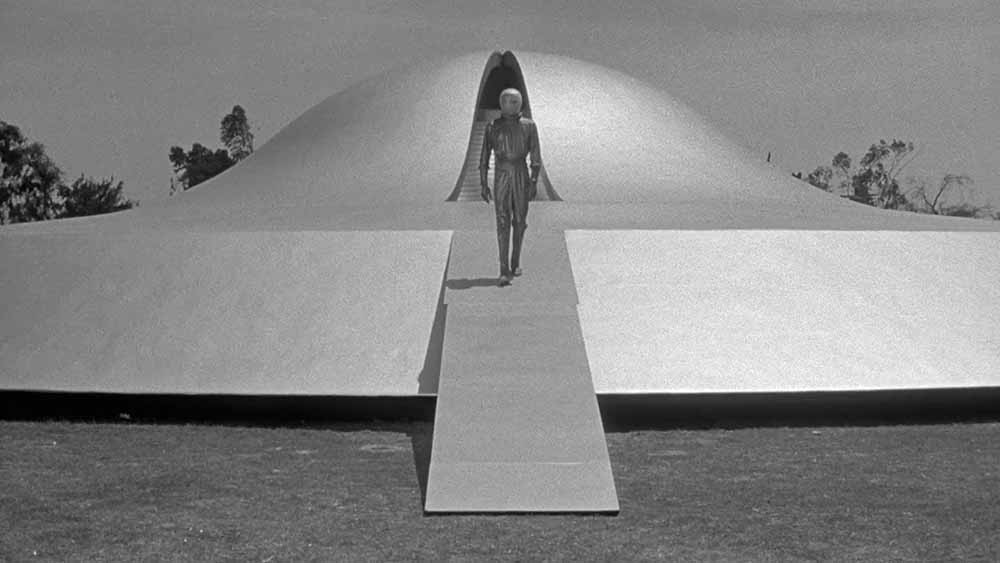

Таркин в «Новой надежде»

Таркин в «Новой надежде»

При создании лица Таркина ILM сопутствовала удача: у них не только было море референсов, но и сам Джон Нолл обнаружил отливку его лица, сделанную еще в 1984 году. Это позволило воссоздать цифровое лицо актера очень близко к оригиналу. На экране в фильме мы видим тело Гая Генри, и цифровую голову за исключением сцен, в которых освещение не позволяло создать такой композит — тогда заменяли и тело.

Однако молодую Лею пришлось воспроизводить только по фотореференсам. Команда студии обнаружила, что в «Новой надежде» Лея меняется, вернее, меняется актриса. Поэтому за основу они взяли сцены из начала фильма, что сюжетно ближе подходило к «Изгою-один».

Актер Гай Генри в процессе захвата мимики

Актер Гай Генри в процессе захвата мимики

Думаете теперь, когда у художников студии есть цифровая копия Таркина, они могут просто перенести всю анимацию с одного лица на другое и получить искомое? Не тут-то было!

Когда Гай Генри играл Таркина, его голос был очень похож на голос Питера Кушинга, но чтобы произвести эти звуки, Гай Генри использовал другие мускулы своего лица. Например, когда Кушинг произносил «а-а», он почти не двигал верхнюю губу. И вот тут на помощь пришли аниматоры ILM. Цифровой Кушинг должен был не только двигаться и звучать как Питер Кушинг, но и при этом шевелить губами как он. Вернее, как он, когда играл Таркина.

Питера Кушинга смоделировали на основе слепка его лица, хранящегося в архивах Lucasfilm

Питера Кушинга смоделировали на основе слепка его лица, хранящегося в архивах Lucasfilm

Когда анимацию закончили, голову отрендерили с помощью нового интегратора RenderMan RIS, который позволил перенести все элементы реакции кожи на свет с оригинальных сканов Lightstage. RenderMan реалистично моделирует то, как свет взаимодействует с кожей и волосами, нужно было только воспроизвести внутри программы освещение, созданное при съемке. Однако здесь команду ILM поджидали дополнительные трудности. Дело в том, что оператор-постановщик «Новой надежды» Гилберт Тейлор освещал декорации иначе, чем Грейг Фрейзер на «Изгое-один». Кроме того, Гарет Эдвардс любит снимать отдельные сцены сам ручной камерой, придавая картинке документальный вид. Поэтому и освещение и движения камеры в обоих фильмах сильно отличаются.

Результат работы

Результат работы

Перед командой ILM встал выбор: сделать Таркина абсолютно похожим, но осветить его сцены иначе, чем остальные, или осветить их, как весь, остальной фильм, пожертвовав сходством персонажа. В итоге они выбрали некую смесь того и другого. Какие-то сцены остались освещены по-новому, а в других схема освещения приближалась к использованной Тейлором в оригинальном фильме. И для них потребовалось заменить Таркина полностью — и тело тоже.

Еще никогда команда ILM не делала цифрового персонажа, которого зрители должны были опознать, как конкретную реальную личность. Это на шаг дальше, чем то, что требовалось для «Варкрафта».

И здесь возникла еще одна проблема: когда цифровой Гай Генри произносил свою фразу, он выглядел как хороший цифровой Гай Генри. Но когда эта мимика «пересаживалась» на лицо Таркина, сразу было видно, что роль играет НЕ Питер Кушинг. Возможно, если бы зрители не знали актера, можно было бы «продать» им эту версию, но зрители прекрасно знакомы с творчеством британского артиста, поэтому он казался ненастоящим.

Если актеры используют разные мускулы для произнесения фразы, которая звучит одинаково, то выглядеть это будет неубедительно, иллюзия исчезает. И это была одна из непредвиденных проблем — даже мим не может имитировать движение мускулов лица абсолютно точно.

Другой проблемой было… линзы. Во время съемки применялись аутентичные исторические анаморфотные объективы (как на «Омерзительной восьмерке»), поэтому ILM пришлось писать специальный софт, имитирующий все «погрешности» оптического рисунка, чтобы созданные на компьютере элементы кадра смотрелись, будто снятые камерой.

Интересно, что создатели снова столкнулись с проблемой восприятия: нужно было создать Таркина не абсолютно близко к тому, каким он был, а как можно ближе к тому, как мы его помним. В 70-х годах освещение на площадке было ярче, а чувствительность пленки ниже, и, соответственно, ее зерно меньше (сегодня мы называем это «шумом»). Сниженная чувствительность пленки требовала более яркого грима. Это выделяло бы Таркина из остальных участников сцены. Этих подробностей никто не помнит, потому что грим всех участников сцены в 1977 году был одинаково ярким. Изучив проблему, команда ILM решила использовать особые схемы освещения — три базовых для сцен с Таркином и одну — для Леи. В фильме 32 шота с Таркином, достигающие по продолжительности 2,5 минут экранного времени.

Принцесса Лея и связь с «Новой надеждой»

Референсами для создания этих кадров послужили концепты и «технические» фото к «Новой надежде». В этих кадрах также понадобилось создавать цифровую одежду. Перед съемками Дейла прошла цифровое сканирование, как Гай Генри. Так кинематографисты получили данные о взаимодействии света с юной кожей принцессы.

Принцесса Лея появляется только в одном шоте фильма, однако, это был один из самых трудоемких кадров всей картины.

Еще по теме

Вышел трейлер «Красный 5» с Денисом Шведовым

ТОП-15 лучших сериалов HBO

В ожидании продолжения «Ведьмака»: 10 похожих сериалов

10 фильмов, полностью (ну, почти) снятых на хромакее: от «Звездных войн» до «Жизни Пи»

7 монтажных фильмов: от династии Романовых до дорожных регистраторов

Мария Вербицкая: «Сценарист не должен ограничивать себя одним форматом»

11 фильмов «2morrow Weekend»